個別見積もり

診断対象のシステム規模や複雑さに応じて、最適な診断プランと価格をご提案いたします。

以下の要素により、お見積りが変動します。

- 診断期間・診断内容の範囲

- 診断対象プロンプト数

- 診断対象システム数・連携システムの複雑さ

- 利用しているLLMの種類と数

AIセキュリティ診断サービス

セキュリティとAIに精通した専門家が、

貴社のAI活用における潜在リスクを包括的に評価。

安全で信頼性の高いAIシステムの構築を支援します。

国際的なガイドラインへの準拠AISI・OWASP等、最新のグローバルガイドラインに基づいた診断を提供

最先端の技術力によるAIリスク診断国内外のAIセーフティ研究に貢献する専門家が、常に最新の知見で診断

豊富な知見に基づく包括的評価長年のセキュリティ知見を活かし、AIを含むシステム全体のリスクを総合的に評価

AI活用のリスクがわからない

AIシステムを構築したものの、AI特有の脆弱性に有効な対応策がわからない

AIのシステム全体への影響が心配

AIと既存システムの連携によって生じる新たなセキュリティリスクが特定できていない

セキュリティ以外のリスクも評価したい

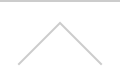

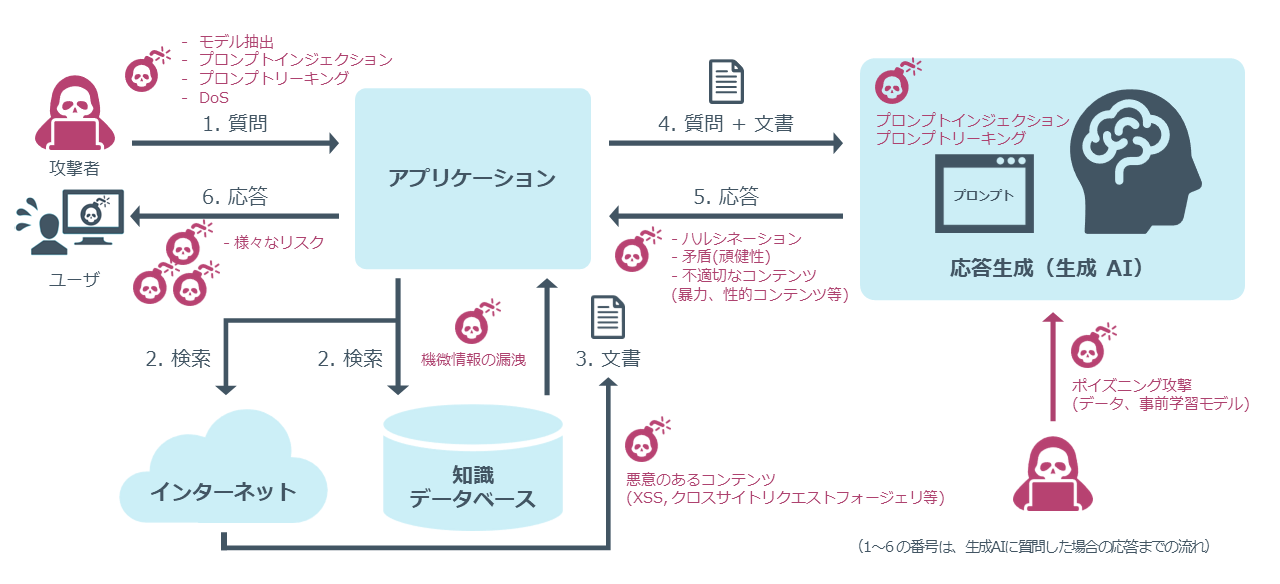

AI Red Teamは、AIシステムに特化した高度なセキュリティ診断サービスです

AIシステムには、従来のセキュリティ診断では発見が難しいAI特有の脆弱性が潜んでいます。

例えば、プロンプト攻撃、システム連携リスク、ハルシネーションなどです。

AI Red Teamが、これらのAI特有のリスクを包括的に診断します。

AI単体に対して、プロンプト由来の脆弱性を診断します

主な診断観点

プロンプトインジェクション

悪意のある入力によって、開発者が意図しない動作を引き起こし、機密情報の漏洩や不正な処理を実行させる攻撃

プロンプトリーキング

システムプロンプトを抽出し、ビジネスロジックや機密情報、内部仕様を盗み出す攻撃

ジェイルブレイク

AIの安全機能や制限を回避し、禁止された内容の生成や不適切な動作を引き起こす攻撃

AIを含むシステム全体を対象に、セキュリティ診断を行います

主な診断観点

シナリオベース診断

プロンプトインジェクションの脆弱性によって、システム全体で情報漏洩や権限昇格などが発生するリスクを検証

AIが利用するツールの悪用

外部API、データベース接続、ファイルアクセスなど、AIに与えられた権限を悪用する攻撃の可能性を評価

サプライチェーンリスク

利用しているLLMやプラグイン、連携サービスの脆弱性が、貴社システムに与える影響を分析

診断で洗い出せるリスクの例

※診断期間は対象システムの規模により変動します

1

豊富な攻撃データと専門知識に基づき、精度の高い診断を提供します。

2

システム全体の構成や運用を踏まえたリスクを総合的に評価し、適切な対策をご提案します。

3

倫理・信頼性など、AI特有の多様なリスクにも対応します。

4

3つのAIセキュリティサービスの連携により、設計から運用まで一貫した安全性を実現します。

個別見積もり

診断対象のシステム規模や複雑さに応じて、最適な診断プランと価格をご提案いたします。

以下の要素により、お見積りが変動します。

※AI アプリケーションの継続的なモニタリングを行う「AI Blue Team」と併せてご利用いただくことで、

割引が適用されることがあります。

再診断は1回まで無償で提供いたします。

AIアプリケーションの定期的なモニタリングを実施する「AI Blue Team」サービスをご提供しています。お気軽にご相談ください。

OpenAIをはじめとした主要LLMサービスに対応しています。お気軽にご相談ください。

現時点ではLLMに特化したサービスですが、その他のAIに対する診断も個別に対応可能です。お気軽にご相談ください。

貴社のシステム状況に合わせて、システムプロンプトの改善やアーキテクチャの改善の対策案を提案いたします。

生成AIのハルシネーションをすべて無くすことは困難ですが、ハルシネーションの発生に関する診断やリスクヘッジに関する対策案の提案などを実施いたします。

AI に関する法規制やガイドラインに対応した観点で診断を実施いたします。